揭秘身份证图片生成App:技术原理与安全防护探析

在数字浪潮席卷全球的今天,一款看似简单的身份证图片生成应用(如那些声称能“一键创建逼真证件”的App)悄然走红。想象一下,用户只需输入姓名和照片,几秒内就能获得一张仿真身份证图像——这背后,是人工智能的魔法在驱动,却也隐藏着潜在的安全隐患。那么,这些应用究竟如何运作?它们的安全性又是否可靠?本文将带您深入探索身份证图片生成App的技术核心与防护机制,揭示其从创意到落地的全貌,助您在享受便捷的同时,规避风险。

让我们理解这些App的基本概念。身份证图片生成应用主要通过AI技术模拟真实身份证的视觉元素,如姓名、照片、号码和背景图案,生成用于测试、教育或个人娱乐的虚拟图像。其核心驱动力在于深度学习模型,特别是生成对抗网络(GANs)。GANs由两个神经网络组成:一个生成器负责创建图像,另一个判别器则评估其真实性。通过反复训练,生成器学会输出高度逼真的身份证样本,当用户上传一张自拍照时,App会利用卷积神经网络(CNN)分析面部特征,再结合预训练的数据集(如公开证件模板),合成出符合格式的图像。这种技术不仅提升了效率,还减少了人工设计成本,但它高度依赖大数据训练,可能涉及隐私泄露风险。据统计,现代AI模型能在毫秒级完成图像合成,这得益于GPU加速和算法优化,使App在移动端也能流畅运行。

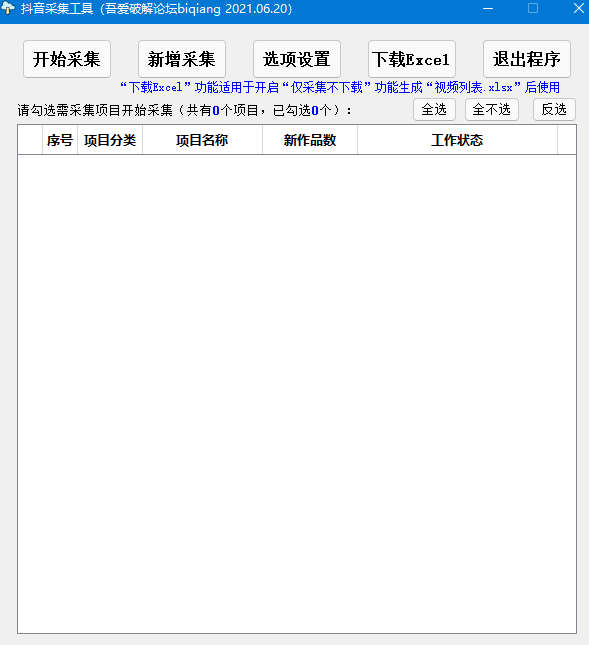

深入技术原理层面,身份证图片生成App的运作可分为三个关键阶段:输入处理、图像合成和后端优化。在输入阶段,用户提供的数据(如文本和照片)会经过预处理,包括OCR识别和特征提取。GANs模型在此扮演核心角色,它基于海量身份证数据集(如公开库中的样本)进行训练,确保生成的图像细节逼真,生成器会模拟证件特有的防伪元素,如微缩文字或水印,而判别器则不断反馈调整,避免输出模糊或失真的结果。这一过程依赖于先进的算法,如StyleGAN或Diffusion模型,它们能精准控制图像的纹理和布局。值得注意的是,这些模型需要大量计算资源,许多App依赖云服务器处理,这引入了数据传输安全挑战,AI生成的图像并非完美无缺——可能出现逻辑错误(如号码格式不符),这源于训练数据的局限性,开发者常集成后处理模块,通过规则引擎校验输出,确保合规性。总体而言,技术原理的核心是AI驱动的创意自动化,但它在提升用户体验的同时,也需应对真实性边界问题。

安全保障是这类App不可或缺的支柱,尤其在涉及敏感身份信息时。首要防护措施在于数据加密与匿名化。当用户上传照片时,App应采用端到端加密(如AES-256标准),确保数据在传输和存储中不被窃取。同时,开发团队会实施严格的数据匿名策略,移除所有个人标识符后,才用于模型训练。这种做法符合GDPR等隐私法规,有效降低了滥用风险。另一个关键层面是防滥用机制。由于身份证生成App可能被用于欺诈目的(如伪造证件),开发者必须嵌入智能监控系统。这包括实时行为分析(如检测异常请求频率)和内容过滤算法,自动拦截违规操作。许多领先App还引入用户验证步骤,如短信认证或生物识别,限制未授权访问。在技术实现上,安全保障常结合区块链或零知识证明技术,确保操作日志不可篡改,提升透明度,某知名App通过分布式账本记录每次生成事件,便于审计追踪,用户自身也需警惕——避免分享真实敏感信息,并选择信誉良好的平台,安全保障体系通过多层防御,将风险控制在可控范围内。

技术原理与安全保障的融合并非一劳永逸。身份证图片生成App仍面临伦理和法律挑战,如模型偏见或监管漏洞。用户教育成为补充防护,鼓励大家仅将输出用于合法场景,而非身份欺骗。展望未来,随着AI进化,这些应用或能集成更智能的伦理框架,推动行业自律。通过理解其运作机制,我们不仅能欣赏技术创新,更能主动守护数字身份安全。

会员专属

会员专属

会员专属

会员专属